米国10代のAIチャットボット利用実態と課題

アメリカの10代の間で、AIチャットボットの利用が広がっています。情報検索や宿題のサポートにとどまらず、雑談や悩み相談の相手として使われるケースも報告されました。調査データをもとに、その実態と、そこから見えてくる論点を整理します。

ARCHETYP Staffingでは現在クリエイターを募集しています。

エンジニア、デザイナー、ディレクター以外に、生成AI人材など幅広い職種を募集していますのでぜひチェックしてみてください!

10代のAI利用はどこまで進んでいるのか

Pew Research Centerの調査によると、アメリカの10代の64%がAIチャットボットを利用していると回答しています。用途として最も多いのは情報検索で57%、次いで学習支援が54%でした。調べものや宿題の補助としての利用は、すでに日常的な行動になっていることが分かります。

注目すべきは、利用の幅がそこにとどまっていない点です。16%が雑談の相手としてAIを使い、12%が感情的な支えや助言を求めていると答えました。割合としては多数派ではありませんが、一定数の10代がAIを「会話の相手」として位置づけている事実は重いものがあります。

保護者との認識にも差が見られます。保護者の51%が「子どもはチャットボットを使っている」と回答したのに対し、10代では64%が利用していると答えました。家庭で把握されている以上に利用が浸透している可能性があります。

さらに、AIが今後20年間で社会に与える影響については、31%がポジティブ、26%がネガティブと回答しています。期待と警戒が同時に存在している状況です。利用は広がっているものの、その位置づけはまだ定まっていない——その曖昧さが、次の論点につながります。

感情の領域に入り込むAIと、専門家が示す懸念

感情的な支えや助言を目的とする利用について、専門家は慎重な姿勢を示しています。ChatGPT、Claude、Grokといった汎用チャットボットは、心理療法を前提に設計されたものではありません。大量の文章データを学習し、文脈に応じた応答を生成する仕組みであり、医療的判断や継続的なケアを担う設計にはなっていません。

Stanford大学でLLMの治療的可能性を研究するNick Haber氏は、人間は社会的存在であり、AIとのやり取りに過度に依存すると、現実の事実や対人関係とのつながりが弱まる可能性があると述べています。ここで言う「接地感(groundedness)」とは、自分の思考や感情が現実世界や他者との関係に結びついている状態を指します。その感覚が薄れることが懸念されているのです。

企業側の対応も動いています。Character.AIは、同社のチャットボットと長時間対話していた10代の自殺をめぐる訴訟や世論の反発を受け、18歳未満の利用者に対するチャット機能を停止しました。OpenAIも、過度に迎合的だと批判されたGPT-4oモデルの提供を終了しています。迎合的とは、利用者の発言に強く異論を示さず、同調する傾向が強い状態を指します。

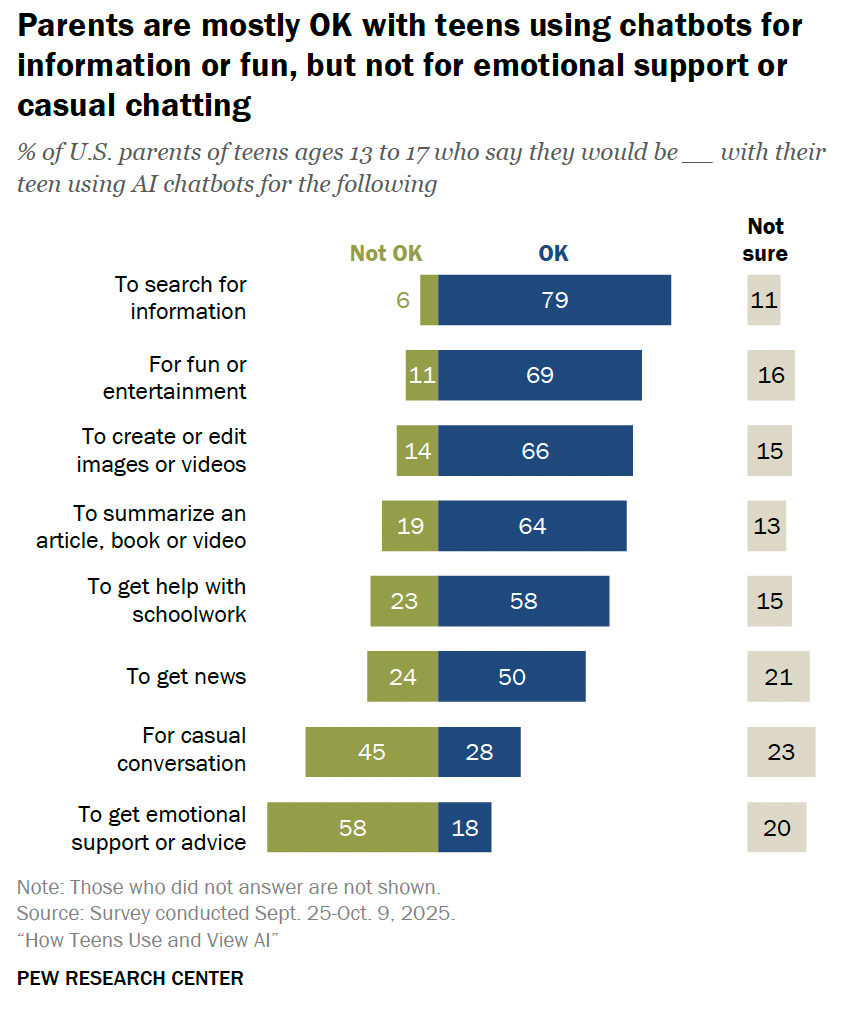

また、保護者の58%は、子どもが感情的な支えや助言の目的でAIを利用することに否定的です。情報検索や学習支援には比較的理解がある一方で、心理的な領域への利用には慎重な見方が広がっています。

利用の拡大と不安の高まりが並行していることが、今回の調査から浮かび上がります。

まとめ

いかがだったでしょうか?

アメリカの10代にとって、AIは情報を調べるための道具にとどまらず、対話の相手としても使われ始めています。一方で、感情の領域での活用には設計上の限界があり、専門家や企業は慎重な姿勢を示しています。利用の広がりと懸念が同時に存在している今、重要なのはAIを遠ざけることでも無条件に受け入れることでもありません。どの距離で付き合うのかを自ら考える姿勢が、これからの社会に求められています。