AnthropicとGoogle・Broadcom提携、AIは計算力競争へ

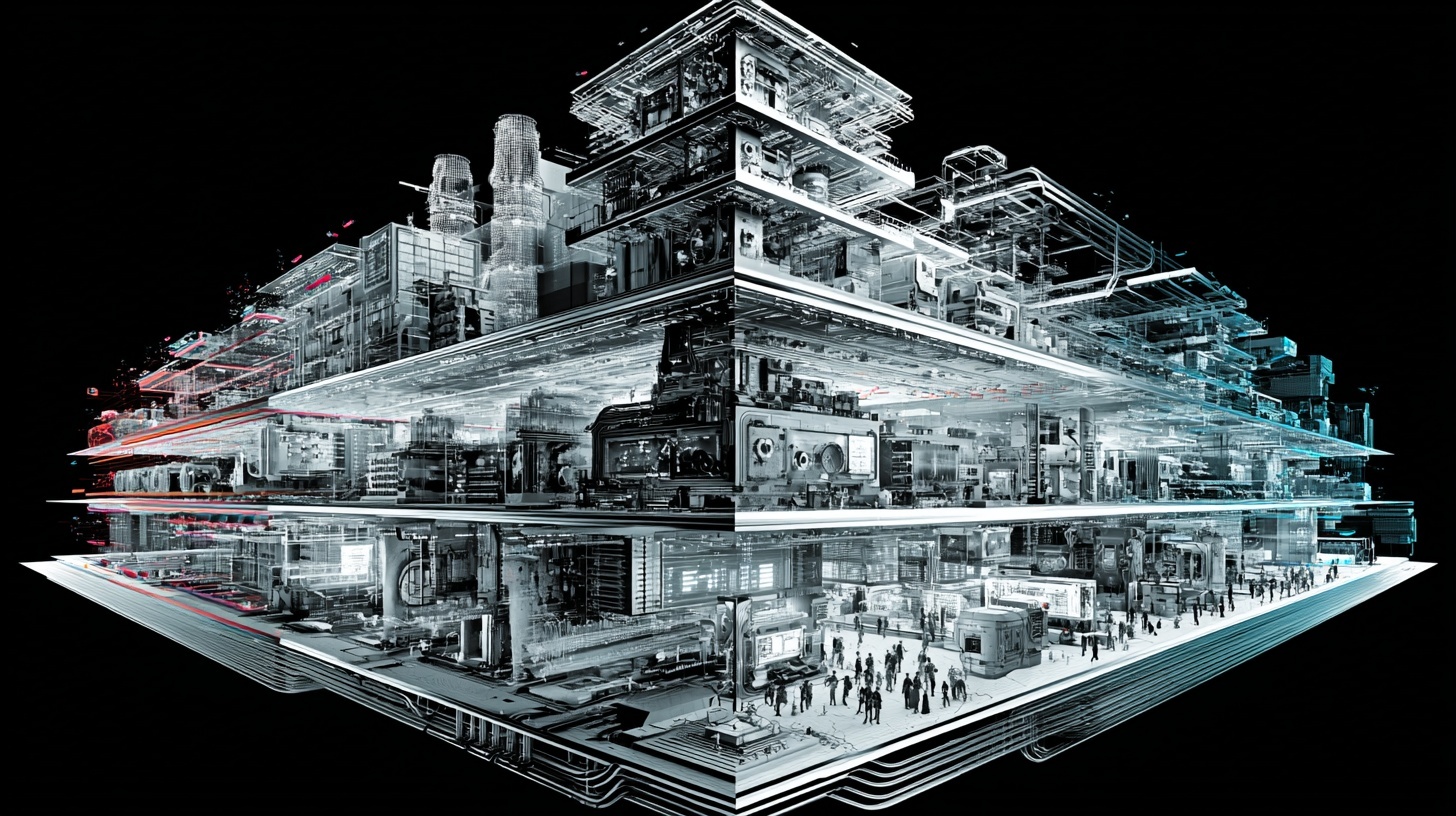

AnthropicがGoogleとBroadcomと連携し、次世代AIに向けた大規模な計算基盤の確保を発表しました。単なる企業間の提携に見えますが、本質はそこではありません。AIの性能を左右する要素が、モデルの精度だけでなく計算量そのものへと移りつつあることを示しています。今、見えにくい裏側で何が起きているのかを整理します。

ARCHETYP Staffingでは現在クリエイターを募集しています。

エンジニア、デザイナー、ディレクター以外に、生成AI人材など幅広い職種を募集していますのでぜひチェックしてみてください!

AIの競争軸は「モデル」から「計算力」へ

今回の発表で注目すべきは、「複数ギガワット規模」という計算力の大きさです。ギガワットは発電所に近い電力規模を指し、それだけ膨大な処理が前提になっていることを意味します。ここで使われるTPUはGoogleが開発したAI専用チップで、大量のデータを効率よく処理するために設計された半導体です。

この設備は2027年以降に稼働する予定であり、設置の大半は米国内とされています。これは、同社が2025年に掲げた米国の計算基盤への投資方針を拡張する流れに位置づけられます。

背景にあるのは、AIモデルの仕組みそのものです。性能はデータ量と計算量に大きく依存し、特にClaudeのような大規模モデルでは、その傾向がより強くなります。モデルの工夫だけでは伸ばしきれず、計算環境の規模そのものが結果に影響する段階に入っています。こうした前提に立つと、AIはソフトウェア単体ではなく、インフラを含めた設計で競われる領域へと広がっていると整理できます。

そして、この変化がそのまま需要の拡大につながっている点も見逃せません。

300億ドルの成長と、AIがインフラ化する現実

Anthropicの事業規模は短期間で大きく伸びています。年間換算売上は2025年末の約90億ドルから、2026年には300億ドルを超えました。加えて、年間100万ドル以上を支出する法人顧客は1,000社を超えており、わずか数か月で倍増しています。これらの数字から、AIが試験的な導入段階を越え、継続的に使われる前提へ移行していることが読み取れます。

提供体制にも特徴があります。ClaudeはAmazon Web Services、Google Cloud、Microsoft Azureのすべてで利用可能であり、利用企業は環境に縛られず導入できます。さらに内部では、AWSのTrainium、GoogleのTPU、NVIDIAのGPUといった異なるチップを用途ごとに使い分けています。処理内容に応じて最適な計算環境を選ぶ設計により、安定した運用が可能になります。

また、Amazonが引き続き主要なクラウドパートナーである点も重要です。複数の基盤を前提としながらも、軸となるパートナーと連携を維持することで、供給体制を安定させています。こうした構成を見ると、AIは単なる便利なツールではなく、継続して提供される基盤として扱われ始めていることが分かります。どの環境でも同じように使え、安定して動くことが前提になりつつあります。

だからこそ、これから重要になるのは「どのモデルを使うか」だけではありません。その裏側で、どのような計算基盤の上で動いているのか――そこまで含めて判断する必要が出てきています。

まとめ

いかがだったでしょうか?

今回の動きから、AIはモデル単体で進化するものではなく、計算基盤と一体となって発展していく段階に入っていることが分かります。特に、どれだけ計算力を確保し、それを安定して提供できるかという点が、今後の重要な判断軸になっていきます。また、AIが一時的なツールではなく、継続的に利用される基盤として組み込まれ始めている点も見逃せません。これからAIを見る際は、表に見える機能だけでなく、その裏側にある構成まで含めて捉えることが重要です。